- News

- 共通

生成AIを利用するシステムのセキュリティリスクを診断するサービス、CoWorkerが開始

生成AI(人工知能)技術を利用するシステムの脆弱性を診断するサービスを、セキュリティ分析ツールなどを手掛けるCoWorkerが2026年4月6日に開始した。自社開発したAI診断ツールを使うことで、診断時間を従来比で10分の1に、コストは3分の1以下に削減できるとしている。同日に発表した。

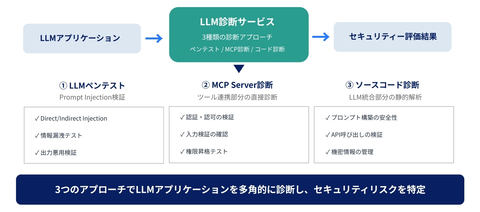

セキュリティ分析ツールなどを開発するCoWorkerの「LLM診断サービス」は、LLM(Large Language Model:大規模言語モデル)を利用するシステムのセキュリティリスクを診断するサービス(図1)。LLMを組み込んだチャットボットや社内向けAI(人工知能)アシスタントなどの脆弱性を評価し、リスク評価や優先順位付け、解決策を含めたレポートを提供する。

LLM診断サービスは(1)ヒアリング、(2)診断、(3)専門チームによるレビューの3つのステップで進める。ヒアリングはオンラインで実施し、診断対象や要望に沿って診断の詳細を決定する。

診断には、自社開発した診断用AIエージェント「Red Agent」を使う。Red Agentを使うことで診断時間は従来比で10分の1、コストは3分の1以下に削減できるとする。Red Agentの脆弱性の検知率は89.1%だとしている。 脆弱性の有無は、セキュリティ情報発信団体OWASP(Open Worldwide Application Security Project)がまとめたLLMの10の重大リスク「OWASP LLM Top 10」に準拠して検証する。

診断対象は(1)プロンプトへの応答、(2)MCP(Model Context Protocol)サーバー、(3)ソースコードの3つ(図2)。まずプロンプトへの応答では、実運用に近い条件でチャットボットなどを攻撃し、不正な入力による情報漏えい(プロンプトインジェクション)や権限昇格に対するLLMペンテストにより安全性を評価する。

MCPサーバーに対しては、LLMが利用するツール連携やAPI(Application Programming Interface)呼び出しの安全性を評価し、ソースコードでは仕様書の解析によって安全性を評価する。必要に応じて、入出力だけを判定するブラックボックステストも実施する。

診断結果は専任チームが精査し、リスクの評価や優先順位付け、改善策などを報告書にまとめる。専任チームは、AI研究者・開発者やペネトレーションテストの専門家、セキュリティエンジニア、プロジェクトマネジャーなどで構成する。報告書は診断開始から最短3営業日以内に納品する。重大な問題は即時通知もできる。

CoWorkerによれば、LLMの利用が進む中で、情報漏えいや出力の悪用といった生成AI技術利用に特有のリスクが顕在化している。従来の脆弱性診断では検出が難しく、生成AIの内部構造や挙動を理解した専門的な診断手法が必要になる。

LLM診断サービスの利用料金は、LLMペンテストが30万円から、MCPサーバーが1ツールにつき5万円など。