- News

- 共通

倫理的で公平・安全な“責任あるAI”の構築・活用支援サービス、PwCコンサルティングが開始

企業が開発・利用するAI(人工知能)システムが、社会に対し倫理的で、公平かつ安全な仕組みであることを担保するための支援サービスを、PwCコンサルティングが2021年7月14日に開始した。AIシステムを使った意思決定によって発生するインシデントや倫理違反、人種・性別などへの偏見や差別、プライバシー侵害といったリスクに対応したガバナンス態勢を構築する。同日に発表した。

PwCコンサルティングの「Responsible AI導入サービス」は、企業が開発・利用するAI(人工知能)システムが、社会に対して倫理的で公平・安全であることを担保するための支援サービス。AIシステムの信頼性と説明可能性を担保することで「責任あるAI」(PwCコンサルティング)として利用できるようにする。

Responsible AI導入サービスでは、開発・利用するAIシステムに対し、利用企業の組織上の課題から個別のユースケース別課題までのAIリスクを特定し、AIシステムの利用やAIガバナンスへの取り組み状況に応じて施策を検討する。

リスクへの対応だけでなく、AIシステムのライフサイクルに応じて、技術的側面や法規制の動向、AIガバナンスの先行事例を踏まえたサービスを提供する。

具体的には、(1)診断、(2)検討・策定、(3)態勢構築(4)対策ツールの導入(5)MLOps(機械学習の開発と運用の統合)の導入(6)教育の6つの支援策を用意する(表1)。

| 支援領域 | 支援内容 | 具体的な項目 |

| (1)診断 | AIガバナンスやAI倫理への対応状況を評価 | ・AIリスクの特定に向けた診断とヒアリング調査 |

| ・ユースケース別AIリスク(法規制や先行事例など)の調査 | ||

| ・AIリスクの課題に対する施策検討 | ||

| (2)検討・策定 | 診断後のリスク対応方針を検討 | ・ポリシーや基準の策定 |

| ・ガイドラインの策定 | ||

| (3)態勢構築 | AIガバナンスの実行プロセスを構築 | ・組織体制の構築 |

| ・実行プロセスの構築 | ||

| ・倫理委員会の設立と運用 | ||

| ・AIガバナンス広報戦略の策定 | ||

| (4)対策ツールの導入 | 説明可能性やバイアス、公平性など、強化が必要な個別のリスクに対応するためのAI運用支援や技術支援 | ・必要なソリューションの設計 |

| ・制御ツールの導入 | ||

| (5)MLOpsの導入 | 機械学習の開発・運用チームやプロセスを構築 | ・モデルの適用と運用 |

| ・アウトソーシングの管理 | ||

| (6)教育 | 責任あるAIの利活用実現に向けた教育 | ・人材育成 |

| ・教育支援 |

AIシステムの利用では近年、種々のインシデントや倫理違反、人種や性別などへの偏見や差別、プライバシーの侵害などが問題視され始めている。欧米では2021年に入り、法規制の強化が活発化している。

例えばEU(欧州連合)がリスクベースのAI規制枠組み案を提示。米FTC(連邦取引委員会)はAI規制による摘発を開始した。日本を含め各国政府が、AIリスクを制御し、AIアルゴリズムに説明責任を負わせるための法的枠組みの構築に着手している。日本でも政府による議論が進んでいるという。

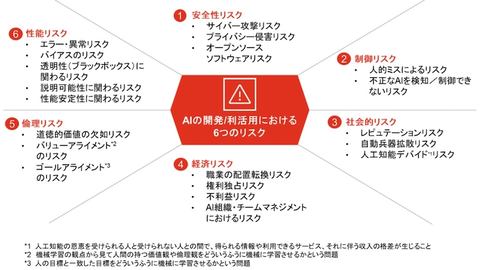

PwCコンサルティングによれば、AIの開発や利活用には、(1)安全性リスク、(2)制御リスク、(3)社会的リスク、(4)経済リスク、(5)倫理リスク、(6)性能リスクの6つのリスクがある(図1)。