- Column

- 信頼できるAIのためのAIガバナンスの実戦的構築法

AIガバナンスが重視するAIライフサイクル【第4回】

前回と前々回は、AI(人工知能)に関わるリスクの特定時に抑えるべきポイントやリスク評価の方法について前後編に分けて解説した。今回は、AIガバナンスの構築において重要なAIのライフサイクルについて解説する。

AI(人工知能)ガバナンスでは、AIのライフサイクル全体にわたりリスクを未然に防ぐ取り組みが推奨される。AIのライフサイクルとは、AIシステムの企画から設計、開発、展開、運用などの一連の流れを意味し、システム構築の各工程のつながりを示すものだ。

ではなぜ、AIモデルやAIシステムはライフサイクル管理が強調されるのか。大きく3つの理由が考えられる。第1は、極めて精巧なAIモデルの研究開発では、社会的な影響に鑑み「構築の初期段階から市場投入の間際まで監視や牽制が必要である」との考えがあり、それがリスクを抑えるための手法として踏襲されているからである。

第2は、AIシステムの構築や運用には多くの事業者(プレイヤー)が関わることから、その責任や役割が不明瞭になり必要な対策が講じられない、あるいは情報が適切に引き継がれないことを憂慮し、一貫性のあるリスクマネジメントを訴求するからだろう。

最後は、AIの出力結果は将来にわたって変化し続けるものであり、また、社会情勢や社会受容性など、社会状況の変化によって不適切な出力になってしまう可能性があるため、繰り返される追加学習や稼働後のモニタリングを重視するためと考えられる。

従来のITシステムは、人が作成したルール(仕様)通りの出力を期待するものだ。一方でAIシステムは、出力結果が一定ではないという前提で構築されることから、従来のITシステムとは性格が大きく異なる。それだけに特に稼働後のリスク顕在化に警鐘を鳴らす必要があると考えられる。

いずれにしても、ここに挙げた理由は、AIガバナンス構築の重要施策としてAIライフサイクルを管理するにあたり抑えておきたいポイントである。

国際的な指針や各国の規制などもAIライフサイクルを尊重

「ライフサイクル」というキーワードは、AIに関する包括法として世界に先駆けて成立したEU(欧州連合)の「EU AI Act(EU AI規制法)」において多数、登場する。「ハイリスクAIシステムのプロバイダーは、ライフサイクル全体を通じてリスク評価を含むリスクマネジメントを計画し、実践しなければならない」とする。また「正確性・堅牢性・サイバーセキュリティーを、ライフサイクルにおいて一貫して設計・開発し、実現しなければならない」ともしている。

EU AI Actでは、これらの基礎になる品質管理として、データ管理、設計、開発、テストおよび検証といった体系的な手順整備と実行を条文に明記している。さらに、その適合状況も評価しなければならないなど、ハイリスクAIシステムの条件に合致した場合のみとはいえ、要求水準は高い。

2023年に開催されたG7広島サミットの結果を踏まえて立ち上げられた国際的な枠組み「広島AIプロセス」の成果文書にも、AIライフサイクル全体にわたるリスクの特定、評価、軽減が記載項目の筆頭に掲げられている。

議長国だった日本はその後、従来は総務省と経済産業省が別々に公表していた複数のガイドラインを「AI事業者ガイドライン(第1.0版)」として取りまとめ、2024年4月に公表した。同ガイドラインにも「ライフサイクル」は随所に登場する。EUをはじめ、その他の先進国だけでなく、他の国々も広島AIプロセスにおける国際指針に基づきライフサイクルを尊重すると考えられる。

また日本は法制度化の検討を進めている。2024年7月に内閣府のAI戦略会議において「AI制度研究会」を設置。2025年2月にAI新法のベースになる『中間とりまとめ』を公表した。

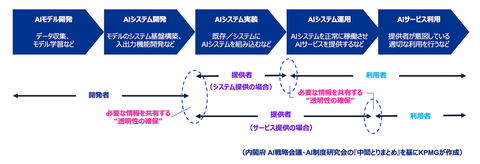

そこでは、AIシステムのステークホルダーには、(1)データ収集やモデル学習、モデルのシステム基盤構築や入出力機能などを開発する者(開発者)、(2)システムにAIを組み込み、利用可能な状態としてAIシステムを提供する者(提供者)、(3)AIシステムを利用する者(利用者)が存在するとしたうえで、AIの安全・安心な研究開発や活用には「開発者 - 提供者間」「提供者 - 利用者間」で情報を共有し透明性を確保すべきだとしている(図1)。

これは、AIライフサイクルの初めから終わりまで(End-to-End)の各段階で、追加学習や想定外の利用などによりリスクが変化していくことを念頭に置いたものである。AIに関わる諸原則のうち、透明性については対応が難しく議論も多いところではあるが、各プレイヤーが果たすべき役割と、AIガバナンスの構成要素になるライフサイクルを関連付けた興味深い論述だと言える。