- Column

- CX(顧客体験)を高めるための生成AIの使い方

顧客接点におけるAI/生成AI技術の活用方法【第3回】

『前回』は、AI(人工知能)/生成AIを活用したコンタクトセンターのイメージを説明しました。その中で、仮想的なストーリーを紹介しましたが、そこでのAI/生成AIの活用は、コンタクトセンター内の業務にとどまっていました。今回は、顧客接点におけるAI/生成AIの活用について説明します。

『第1回』で説明したように、現時点でソースが公開されている生成AI(人工知能)技術の課題として、社内データや顧客情報などが流出するリスクや、明らかに間違った答えを生成してしまう「ハルシネーション(幻覚)」が指摘されています。

そのため多くの企業が、AIを顧客との接点に直接活用することには慎重な姿勢をとっています。顧客接点で万一、AIが間違った答えを返してしまえば大きな問題になるからです。顧客の懸念を見極めながら、AI技術を慎重に評価し、業務全体にどうシームレスに統合するかを検討することが重要です。

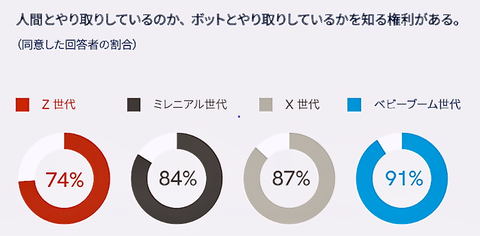

顧客自身がAIによる対応を望んでいない可能性も指摘されています。ジェネシスの調査によると、やり取りしているのが人かAIボットなのかについて「知る権利がある」とする割合は、いずれの世代でも70%を超えます(図1)。「AIに答えられても嬉しくない」と考える顧客が多ければ、AI技術を使っていることを大々的にアピールすることは逆効果になりかねません。特に日本では「おもてなし」や「ホスピタリティ」を重視する文化が根付いているだけに、利用場面によっては、AI技術による対応と、対人ならではの対応とのバランスを取ることが重要になります。

このように顧客とダイレクトに接するポイントでは、まだまだ人間のオペレーターが対応しなければならないとすれば、現時点でのAI/生成AIは、人的リソースをなるべく効率的に活用できるようにAI/生成AIを使い、エクスペリエンス・オーケストレーションを通じてシームレスな旅を顧客に提供するのが正解でしょう。バックエンドでの活用にとどめるにしても、AI/生成AIの効果は十分に感じられるはずです。

そして、バックエンドでの活用の延長線上には、コンタクトセンターのオペレーターを側面から支援することでEX(Employee Experience:従業員体験)を高め、その結果としてCXの向上に結びつけていくという方向性も見えてきています。EXについては次回に詳しく紹介しますが、今回はCXに焦点を絞って説明します。

進化の早いAI/生成AIの顧客接点での利用が動き出している

AI/生成AIは、もの凄い勢いで進化しています。それだけに、現時点での問題点が解決されるのも、そう遠いことではないでしょう。そのときに慌てないための準備として、AI/生成AIへの取り組みは進めておかねばなりません。

実際すでに、顧客接点へのAI/生成AIの適用は動き出しています。ボットの精度向上やFAQ(よくある質問と答え)の作成と改善、行動分析によるWebの動線やカスタマージャーニーの改善・最適化、オムニチャネル対応などです。

ボットの精度向上

顧客接点におけるAI/生成AIの適用先として真っ先に思い浮かぶのが、チャットボットや音声ボットの精度向上でしょう。ボットを導入済みの企業が既に、この分野に取り組んでいます。特に生成AIに対しては、音声認識や自然言語処理の精度を飛躍的に高められ、顧客の質問意図を正確にくみ取った適切な受け答えが期待されています。

特に音声ボットについては、将来的にはボットから「バーチャルエージェント」あるいは「バーチャルコンシェルジュ」などと呼ばれる仕組みにまでに進化する可能性があります(ジェネシスの「バーチャルエージェント」のユースケース動画)。

音声ボットの進化の過程としては以下の6段階が考えられます。実例は少ないものの、現在の技術でも第3段階や第4段階までは実現されています。今後はRAG(Retrieval-Augmented Generation:検索拡張生成)の活用や他システムとの連携により、よりパーソナライズされたセルフサービス化が実現されていくでしょう。

第1段階 :ルールベースの音声ボット。IVR(Interactive Voice Response:音声自動応答)での番号入力に替わる分岐指示や認識、簡単な要件への対応など

第2段階 :事前に定めたルールに沿いながらも、顧客の発話のゆらぎをある程度吸収し、要件に応えるための情報を収集できるような音声ボット

第3段階 :高い音声認識精度とデータソース照合により、住所の聞き取りや本人認証といった高度な処理に活用できる音声ボット

第4段階 :顧客がガイド通りに発話しなくても、意図を一定程度くみ取れるような音声ボット

第5段階 :LLM(Large Language Model:大規模言語モデル)を活用し、企業独自のナレッジやFAQを考慮した対話フローを利用できるような音声ボット

第6段階 :LLMを活用し、顧客の個人情報を扱えるような対話フローを実行し、その情報を外部に流出させないように考慮された音声ボット

従来の音声ボットは、精度を担保するために、限定的な質問によって対話内容を制御しています。そこに生成AIやLLMを利用すれば、例えば「大人2人と子供2人で」といった発話内容から「人数は合計4人である」といったことの認識や、顧客の自由な発話からの内容の理解、顧客の過去の行動や履歴の分析結果に基づく個別最適化した対応なども可能になります。

ただ上述したように、顧客対応を100%、AI/生成AIに任せるのはリスクが高いと考えられます。AI/生成AIをカスタマージャーニーのどこに導入するかは慎重に検討する必要があります。現時点では、顧客とボットのやり取りを蓄積したデータをAI/生成AIで分析してシナリオの改良に役立てたり、顧客とボットのやり取りを追跡し適切なタイミングで最適な人間のオペレーターにエスカレーションしたりすることが考えられます。この際、顧客の問い合わせに最適なエージェントを割り当てる予測ルーティング技術を活用することも可能です。

エスカレーションの際に、それまでのやり取りの要約や過去の履歴などを正確かつ手短にオペレーターに申し送りすることも可能です。間接的にではありますが、ボット利用時のCXは確実に向上するでしょう。