- Column

- Digital Vortex、ディスラプトされるかディスラプトするか

国家の未来を掛けたAIイノベーション戦略(後編)【第15回】

Goggleでは従業員がAIの倫理的問題を指摘

AIの軍事利用に対し従業員からの反対運動が起こり、顧客との契約を更新できなかったのがGoogleだ。

同社では2018年4月、Google Cloud部門が米国防総省(ペンタゴン)と軍事用ドローンの監視機能を強化するAI開発契約「Project Maven」を結んだ。だが、軍事用ドローンの画像認識機能向上にAI技術が応用されることは倫理上問題があるとして、従業員の約4000人がペンタゴンとの提携解消をCEOに求める嘆願書に署名した。これを受けGoogleは、2019年の契約を更新しないことを決定した。

Googleは2016年に開発方針を「AIファースト」に転換した。AIの倫理的側面において従業員からは、企業の行動がGoogleの信念である「Don’t be evil」(2018年5月頃まで使われていた)や「Do the right thing」に反していると指摘されたのだ。

2018年6月には『AI at Google:Our Principal』を公表し、AIの倫理に関する問題を提起するとともに、AI開発を軍事用途には利用しないことを明言した。さらに、有害な技術、危害を与える技術、規範に反する技術、国際法の理念や人権に反する用途のための技術といった分野にも、AIの開発および普及させないことも宣言した。

AI at Google: Our Principalでは、主に次の7つの視点でAIアプリケーションを評価するとしている。

視点1:社会的に有益であること

視点2:不公平なバイアスの抑止

視点3:安全性を念頭に置いた開発と検証

視点4:説明責任

視点5:プライバシーデザインの原則の適用

視点6:科学的に卓越している事の探求

視点7:これらの基本理念に沿った利用への技術提供

倫理的課題に直面した際の素早い決断が重要

AIイノベーションは、技術開発、規制や制度といった環境整備などを含めて、まだ発展途上段階にある。倫理的課題にも上手く準備し、対処していかなければならない。当面は、実務面ではAIが導く結果を鵜呑みにせず、最終的な判断には人間が介在し決定することが重要だ。

加えて大切なことは、AmazonやGoogleの動きにみられるように、自社のAIイノベーションの取り組みが倫理的課題に直面したと認識するや否や、素早く決断し、問題解決に向けて行動を起こすことだ。デジタルディスラプター自身が、デジタルビジネスアジリティを見事に実践している点を見逃してはならない。

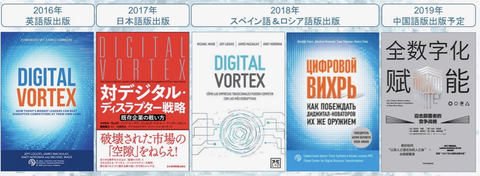

なお、デジタルボルテックスを解説した『対デジタル・ディスラプター戦略』(日経経済新聞出版社)は、2016年の英語オリジナル版を2017年10月に日本語訳したものだ。本書はその後、2018年にスペイン語とロシア語にも翻訳され、中国語への翻訳が進んでいる(図3)。世界中のビジネスリーダーが、デジタルボルテックスに注目しているのである。

今井 俊宏(いまい・としひろ)

シスコシステムズ合同会社イノベーションセンター センター長。シスコにおいて、2012年10月に「IoTインキュベーションラボ」を立ち上げ、2014年11月には「IoEイノベーションセンター」を設立。現在は、シスコが世界各国で展開するイノベーションセンターの東京サイトのセンター長として、顧客とのイノベーション創出やエコパートナーとのソリューション開発に従事する。フォグコンピューティングを推進する「OpenFog Consortium」では、日本地区委員会のメンバーとしてTech Co-seatを担当。著書に『Internet of Everythingの衝撃』(インプレスR&D)などがある。